티스토리 뷰

-

대용량 데이터 집합을 분석

-

컴파일을 하기 때문에 속도가 느리다

-

하둡이 있어야 함

설치

-

pig-0.17.0.tar.gz 다운

-

압축풀기

-

폴더이름 변경

-

환경변수 변경 후 재부팅

-

HADOOP_HOME 이 반드시 있어야함

-

작업 히스토리 서버 시작

-

확인

-

pig 실행

정형 데이터 분석

-

하둡에 pig 폴더 생성

-

데이터 확인

-

Pig에서 실행

-

하둡 pig폴더에 있는 passwd.txt 를 : 을 구분자로 하여 불러옴

-

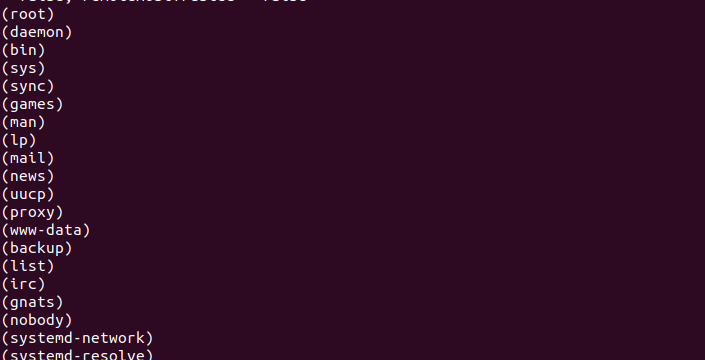

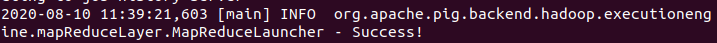

맵리듀스로 작업하여 화면에 출력

-

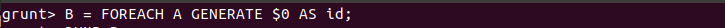

튜플 중 맨 처음 값의 이름을 id로 가져와 B에 저장

-

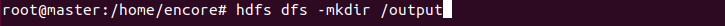

하둡 폴더에 결과를 출력할 폴더 생성

-

B의 값을 /output/pig 폴더에 저장

-

같은 이름의 폴더가 있으면 안된다.

-

결과 확인

비정형 데이터 분석

-

pig에 데이터 불러오기 (구분자 공백)

-

평탄화 작업

-

튜플 안에 튜플이 있을 경우 : (a, (b,c)) -> (a, b, c)

-

내용 출력

-

word-count

-

word로 묶기

-

word로 묶고 개수 세기

-

D의 결과를 pig 폴더에 저장

-

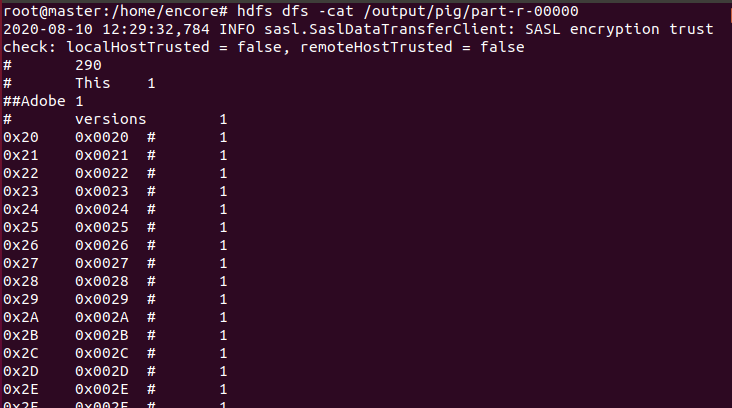

결과 확인

-

결과 파일 다운로드

'Hadoop' 카테고리의 다른 글

| 빅데이터 플랫폼 구축 #2 - CentOS 설치 (0) | 2020.10.02 |

|---|---|

| 빅데이터 플랫폼 구축 #1 - VMware 설치, 네트워크 설정 (0) | 2020.10.02 |

| Sqoop (0) | 2020.08.15 |

| Flume (0) | 2020.08.14 |

| Hadoop - Multi Node Cluster (0) | 2020.08.13 |

댓글

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- Free space management

- hadoop

- Flume

- gradle

- 빅데이터 플랫폼

- mapreduce

- Disk Scheduling

- File Protection

- jdbc

- Spring

- Java

- aop

- springboot

- Variable allocation

- Disk System

- oracle

- Replacement Strategies

- SQL

- 빅데이터

- JSON

- I/O Mechanisms

- Allocation methods

- SPARK

- maven

- RAID Architecture

- HDFS

- linux

- I/O Services of OS

- 하둡

- vmware

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |

글 보관함