티스토리 뷰

hdfs의 데이터를 spark로 실행해서 hdfs에 적재

-

테스트 데이터

< test.txt >

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다

안녕하세요!! 스파크 입니다< SparkTestStep2.java >

package bigdata.spark.basic;

import org.apache.spark.SparkConf;

import org.apache.spark.api.java.JavaRDD;

import org.apache.spark.api.java.JavaSparkContext;

public class SparkTestStep2 {

public static void main(String[] args) {

SparkConf conf = new SparkConf();

conf.setAppName("firstProgramming");

conf.setMaster("local");

JavaSparkContext sparkContext = new JavaSparkContext(conf);

// 1. hdfs에서 파일 읽기

JavaRDD<String> textRDD

= sparkContext.textFile("hdfs://192.168.111.129:9000/spark/test.txt");

// 2. 파일 데이터를 처리 - 내부에서 메모리에 적재하고 처리

textRDD.foreach(line -> System.out.println(line));

// 3. 결과를 hdfs에 저장하기

textRDD.saveAsTextFile("hdfs://192.168.11.129:9000/spark/result1");

}

}

-

jar 파일 export

-

jar파일과 test.txt파일을 hadoop01머신으로 복사

-

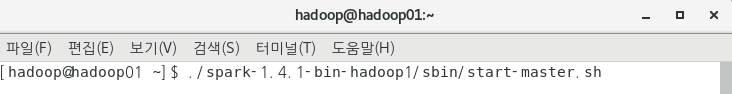

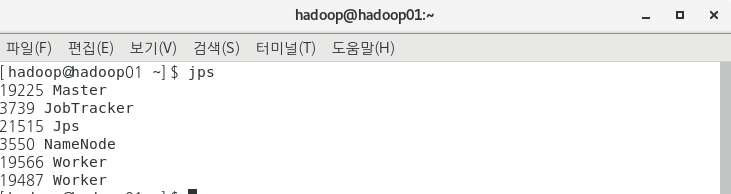

하둡, 스파크 실행

-

확인

-

HDFS에 test.txt 파일 넣기

-

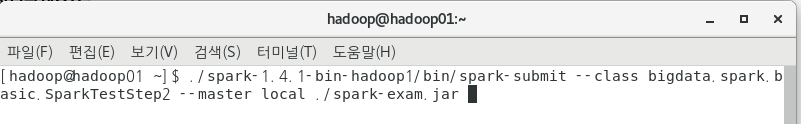

스파크 실행

-

결과

'Hadoop' 카테고리의 다른 글

| 빅데이터 플랫폼 구축 #18 - Spark : WordCount (0) | 2020.10.23 |

|---|---|

| 빅데이터 플랫폼 구축 #17 - Spark : flatMap (0) | 2020.10.23 |

| 빅데이터 플랫폼 구축 #16 - Spark : 설치 및 테스트 (0) | 2020.10.22 |

| 빅데이터 플랫폼 구축 #15 - 커스터마이징(2) : 보조정렬 (0) | 2020.10.21 |

| 빅데이터 플랫폼 구축 #14 - 커스터마이징(1) : Combiner (0) | 2020.10.18 |

댓글

공지사항

최근에 올라온 글

최근에 달린 댓글

- Total

- Today

- Yesterday

링크

TAG

- JSON

- Replacement Strategies

- aop

- 하둡

- Flume

- 빅데이터 플랫폼

- HDFS

- jdbc

- maven

- mapreduce

- oracle

- gradle

- Variable allocation

- vmware

- 빅데이터

- linux

- SQL

- Allocation methods

- RAID Architecture

- File Protection

- I/O Services of OS

- Spring

- hadoop

- I/O Mechanisms

- springboot

- Java

- Free space management

- Disk Scheduling

- SPARK

- Disk System

| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | 3 | 4 | |||

| 5 | 6 | 7 | 8 | 9 | 10 | 11 |

| 12 | 13 | 14 | 15 | 16 | 17 | 18 |

| 19 | 20 | 21 | 22 | 23 | 24 | 25 |

| 26 | 27 | 28 | 29 | 30 | 31 |

글 보관함